Movimientos transfronterizos de desechos de equipos eléctricos o electrónicos, según los resultados del Proyecto para el fortalecimiento de las iniciativas nacionales y mejora de la cooperación regional ante el manejo ambientalmente racional

Haga click en imagen para ampliar

El proyecto para el fortalecimiento de las iniciativas nacionales se centró en el proceso de validación de la legislación y de las estadísticas en los países americanos de los Andes, del Sur y del Caribe. Fue financiado por el Fondo para el Medio Ambiente Mundial (FMAM) y coordinado por la Organización de Naciones Unidas para el Desarrollo Industrial (ONUDI).

Aun cuando los 13 países estudiados en la región poseen marcos legales y normativos desarrollados para la gestión de residuos, la mayoría de ellos carece de legislaciones específicas en materia de residuos electrónicos y de sistemas de responsabilidad extendida del productor. Tal compromiso es definido como un grado de obligatoriedad por todos los impactos ambientales de sus productos a lo largo del ciclo de vida de desarrollo.

Ante la visión de las estadísticas regionales acerca de los aparatos eléctricos y electrónicos (AEE) puestos en el mercado (POM), el informe sostiene que han fluctuado pero no así los residuos de los aparatos, durante el periodo 2010 a 2019.

Se destaca del “Monitoreo mundial de los residuos electrónicos 2020: Cantidades, flujos y potencial de la economía circular” la exclusión de la actividad de la empresa colombiana “Computadores para Educar” relacionada con la “retoma y demanufactura de computadores obsoletos para aprovechar sus componentes en procesos pedagógicos para el aprendizaje”.

El siguiente cuadro de cifras permite deducir los serios retos de la región para convertir los AEE-POM en residuos de aparatos eléctricos y electrónicos (RAEE) reciclables, conforme el Convenio de Basilea.

El total de AEE-POM regional detalla este comportamiento: de 1.7 toneladas métricas (Mt) en 2010 se ascendió a 1.9 Mt en 2017 pero en 2019, al disminuir las importaciones, los AEE se redujeron a 1.7 Mt. La caída en compras importadas obedeció a las crisis económicas nacionales en los 13 países analizados. De otro lado, la generación de RAEE en la región aumentó en 49%, al pasar de 0.9 Mt (4.7 kg/hab.) en 2010 a 1.3 Mt (6.5 kg/hab.) en 2019.

En términos demográficos, los 13 países en conjunto, en 2019, tenían 206 millones de habitantes. Argentina el más poblado (45 millones), seguido de Perú (32,5 millones) y Venezuela (28 millones). Entre 2010 y 2019 ─periodo del monitoreo─ la tasa de crecimiento de la población fue en promedio 10%. El de mayor tasa en este período fue Guatemala (20%), seguida de Honduras (17%), Bolivia, Panamá y Ecuador (15% cada uno). El de menor tasa de crecimiento poblacional fue Uruguay (4%).

Más de 5 millones de personas emigraron debido a las crisis económica y política a niveles nacionales, de los cuales cerca del 80% residen en otros países de América Latina.

La diferencia de poder económico por habitante es amplia en los países estudiados y casi toda la población tiene acceso a internet y a electricidad, a excepción del 68% de Nicaragua. Entre 1% y 4% de la población de Venezuela, Costa Rica, Ecuador, Nicaragua, El Salvador, Panamá y Perú se encuentra por debajo del umbral de la pobreza (1,90 dólares al día), mientras que 9% de Guatemala y 16% de Honduras viven por debajo de ese umbral.

Los 13 países de América Latina participantes en el estudio han ratificado el Convenio de Basilea ─incluido Colombia mediante la ley 253 de 1996─ y han promulgado prohibiciones nacionales sobre las importaciones de residuos electrónicos pero todavía no hay aplicación de medidas importantes.

Problema internacional

El informe del monitoreo destacó, que a nivel mundial, sólo 17% se recoge y recicla oficialmente, lo que supone un desperdicio de materiales valiosos. En 2019, se generó la cifra récord de 53,7 millones de Mt de residuos electrónicos, un incremento del 21% desde 2014.

Los aparatos eléctricos y electrónicos (AEE) ─computadoras portátiles, teléfonos celulares, refrigeradores, lavadoras, lavaplatos, aparatos de cocina, juguetes, servidores e instrumentos musicales─ cuando son desechados por su propietario, sin intención de reutilización, se convierten en residuos de aparatos eléctricos y electrónicos (RAEE). Y este ciclo de uso, normal y cotidiano, esconde la verdadera cuestión de los materiales valiosos y peligrosos. Es decir, los AEE contienen productos y piezas que funcionan con una fuente de alimentación eléctrica o una batería y al desecharlos son fuertes contaminantes del ambiente y de la salud.

La mayoría de los RAEE sin reciclaje se eliminan en vertederos, que mezclados con otros flujos de residuos orgánicos, matan de manera racional el ecosistema ambiental y generan riesgo para la salud de todas las especies vivas. El desafío por los residuos electrónicos sigue siendo mundial ya por el aumento de compra de aparatos, ya por el tratamiento inadecuado al botarlos, ya por la poca prevención global de reciclaje, etc. Por tanto, se requieren compromisos activos desde un conjunto diverso de actores que trascienda las fronteras nacionales.

Líneas adicionales agravan el asunto debido al aumento del desarrollo general de las sociedades y la rápida transformación de la tecnología de información y comunicación. Además, los AEE se están extendiendo al instante en sectores emergentes como transporte eléctrico, producción de energía limpia y ciudades inteligentes, que apoyan sus servicios en sensores de fuentes eléctricas.

Una acción es objetivo de seguimiento en los Objetivos de Desarrollo Sostenible (ODS) de Naciones Unidas sobre consumo y producción sostenibles pero aún falta más por ejecutar. Para 2023 la Agenda Conectar de la Unión Internacional de Telecomunicaciones (UIT) estableció dos finalidades: aumentos hasta 30% de la tasa de reciclaje de RAEE a nivel mundial e incrementos del número de países con legislación sobre residuos electrónicos para que llegue hasta 50%. Propósito frustrado de operaciones.

El problema internacional lo complementa la contaminación de los orgánicos persistentes (COP) ─por ejemplo, los plaguicidas─ producidos intencionadamente o liberados involuntariamente a partir de procesos de combustión o reacción incompletos. Aquellos se encuentran en muchas partes: en nuestros alimentos, en el suelo, en el aire, en el agua, generando efectos adversos como cáncer, alergias e hipersensibilidad, daños en el sistema nervioso central y periférico, trastornos reproductivos y alteraciones del sistema inmunitario.

Tales peligros se deben a cuatro de sus características: a) son tóxicos; b) son persistentes porque resisten los procesos normales de descomposición; c) se acumulan en la grasa corporal de todas las especies vivas y se transmiten de la madre al feto; y d) pueden recorrer grandes distancias con las corrientes de viento y las de agua.

Los 13 países incluidos en el monitor regional han culminado la ratificación, aceptación, aprobación o adhesión al convenio de Estocolmo sobre COP. Ahora, cada país tendrá que elaborar un marco político para la gestión eficaz de los COP, según estipula el Plan Nacional de Implementación para, por lo menos, 28 compuestos o grupos de compuestos incluidos en la lista de contaminantes orgánicos persistentes del convenio.

Movimientos transfronterizos de los RAEE

El Convenio de Basilea 2019 sobre control de los movimientos transfronterizos de los desechos peligrosos y su eliminación es el único tratado mundial sobre residuos peligrosos que incluyen a los residuos electrónicos. Este protocolo de responsabilidad e indemnización por daños resultantes de los movimientos transfronterizos de desechos peligrosos define la "peligrosidad" de los residuos sobre la base de las sustancias presentes en los materiales de desperdicio y los clasifica como peligrosos o no peligrosos, en función de sus propiedades químicas. Por ejemplo, Guatemala menciona específicamente las mezclas químicas y el amianto.

El Salvador, Costa Rica, Guatemala, Honduras, Nicaragua y Panamá son partes del acuerdo centro regional sobre movimiento transfronterizo de desechos peligrosos, firmado el 11 de diciembre de 1992, cuyo objetivo es controlar el movimiento entre fronteras de los residuos peligrosos y prevenir el tráfico ilegal y la eliminación de tales desechos en Centroamérica. También se establece la prohibición de importar cualquier tipo de residuos peligrosos desde fuera de la región. Los demás siete países de América Latina prohíben la importación de desechos peligrosos en sus territorios pero no tienen restricciones específicas de exportación de residuos electrónicos, a no ser que se destinen a su reciclaje y de conformidad con el Convenio de Basilea.

En consecuencia, aplicar las medidas de Basilea sigue siendo un adicional reto importante para los 13 países de la región de Latinoamerica. Muchos países no presentan informes a Basilea sobre los movimientos transfronterizos, tampoco registran datos oficiales de importación y exportación de residuos electrónicos, entre 2016 y 2019, como por ejemplo Bolivia, Chile, Ecuador y Panamá.

Aunque hay pruebas de importación y de exportación de AEE usados en la región, no hay estadísticas oficiales en ninguno de los 13 países estudiados. Tampoco restringen la exportación de residuos peligrosos y de otros residuos para su eliminación final o recuperación, Honduras, como excepción, restringe el tránsito de residuos incluidos los peligrosos pero los operadores de residuos electrónicos exportan partes valiosas ─tarjetas de circuitos impresos, verbigracia─ a Panamá, México, Canadá y Estados Unidos sin notificar a Basilea.

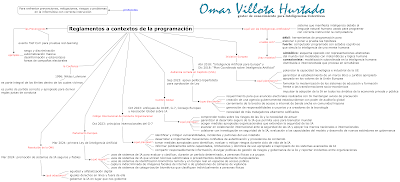

Un resumen de los resultados del análisis de los movimientos transfronterizos de residuos electrónicos en los 13 países de América Latina muestra que:

- ningún país analizado informó de casos de importación de COP y de residuos electrónicos, ni los ha declarado a Basilea;

- ninguna de las legislaciones permite la importación de desechos peligrosos para su recuperación, eliminación final u otro fin;

- cuatro (Bolivia, Chile, Ecuador y Panamá) no han proporcionado informes anuales sobre estos artículos según el Convenio para los años 2018 y 2019;

- nueve (Argentina, Costa Rica, El Salvador, Guatemala, Honduras, Nicaragua, Perú, Uruguay y Venezuela) informaron a Basilea estadísticas de movimientos transfronterizos;

- seis (Argentina, Costa Rica, El Salvador, Nicaragua, Perú y Venezuela) exportan residuos electrónicos a varios destinos para su tratamiento y recuperación de materiales;

- Chile almacena pantallas CRT, conectores y condensadores hasta que alcanzan un volumen suficiente para exportarlos a recicladores en Bélgica;

- Nicaragua exportó alrededor de 60 toneladas de residuos electrónicos procedentes de hogares y empresas para su gestión ambientalmente racional;

- Ecuador prohíbe específicamente la importación de COP y otros productos agroquímicos prohibidos internacionalmente.

Según informes presentados por los países a Basilea, se estima que 7.4 toneladas de residuos electrónicos son exportados pero la carencia de notificación, la mala calidad de los datos y el pésimo control de los movimientos transfronterizos de aquellos representan una amenaza para la gestión ambientalmente racional de los residuos electrónicos y los movimientos ilegales.

Recomendaciones

El estudio determina cinco principales razones de las bajas tasas de recolección de residuos considerando que: más del 97% de los electrónicos generados en los países analizados no se recogen ni se envían a instalaciones específicas para la adecuada gestión ambientalmente racional; que la mayor parte de los residuos electrónicos acaban en vertederos o son gestionados por el sector informal; y que los plásticos que contienen COP y retardantes de llama bromados (BFR) se eliminan en vertederos, también.

1) Aumento de los volúmenes de residuos electrónicos. La generación de residuos electrónicos en los países monitoreados creció 49% entre 2010 y 2019, una tasa de crecimiento más rápida que el promedio mundial de 12%. También creció la generación de plásticos BFR ─mezclas de productos químicos artificiales añadidos para hacer menos inflamables a una amplia variedad de productos industriales, textiles y equipos eléctricos o electrónicos─ de 0,02 Mt en 2010 a 0,03 Mt en 2019, lo que representa un crecimiento del 47%. Mientras la tasa de recolección de residuos electrónicos fue 2,7% en 2019.

Si estas tasas de recolección no mejoran sustancialmente, la cantidad absoluta de RAEE y de plásticos BFR en los residuos electrónicos no gestionados seguirá aumentando. Por lo tanto, se recomienda recoger más mediante el establecimiento de una cantidad adecuada de puntos de recogida de fácil acceso, correlacionados con la densidad territorial, y acompañada de mayor sensibilización entre los usuarios finales.

De aumentar las tasas de recolección de RAEE en todos los países de la región, al igual que en el resto del mundo, se tendría una mejora indudable. Se puede lograr mediante la entrega obligatoria de residuos electrónicos a instalaciones autorizadas para evitar la inseguridad que roba las partes valiosas. Dicha recogida debe ser cuantificable, por lo que se debe optimizar la recepción de estadísticas anuales sobre AEE-POM en un formato comparable para facilitar la evaluación del rendimiento del sistema y la de los flujos no gestionados cada cinco años. Esta estrategia sería una obligación de información para todos los actores que recogen residuos eléctricos y electrónicos.

2) Ausencia de una legislación específica. Siete países la carecen por lo que se hace imposible implementar y aplicar objetivos de recogida para su gestión ambientalmente racional. Otros cinco países cuentan con prerrequisitos básicos para la gestión de los residuos electrónicos, que incluyen legislación, iniciativas de responsabilidad extendida del productor, mecanismos de recogida para algunos productos e infraestructuras de reciclaje. Algunos otros no evalúan las leyes necesarias secundarias de aplicación a la normativa sobre responsabilidad extendida del productor, por lo que no establecen objetivos de recogida aplicables. Otros países aplican dichas leyes solo a algunos productos.

Tal ausencia de legislación específica para la gestión de los residuos electrónicos implica invariablemente que la mayor parte de los plásticos BFR sean gestionados por el sector informal y que la mayoría de los residuos electrónicos acaben en vertederos o sean quemados al aire libre. Aunque todos los países de América Latina cuentan con legislación para la gestión de los COP, su aplicación es poco rigurosa y las instalaciones para su tratamiento son inexistentes.

Las recomendaciones de prevenir más y tratar mejor con menos contaminación son modos que conforman la jerarquía de los residuos. La primera se ejecutaría mediante la Directiva marco europea 2008/98/CE sobre la gestión de los residuos que establece con claridad que la prevención y la reutilización de residuos deben constituir la primera prioridad de la gestión de residuos.

Actualmente, la mayoría de los grupos industriales y las políticas públicas se centran en el reciclaje y la eliminación segura de los residuos electrónicos más que en la reutilización de los AEE. Aun así, patrones de producción y consumo siguen fascinando a compradores por la modernidad de los AEE, los bajos precios de las nuevas tecnologías y los nuevos modelos e innovaciones que frecuentemente los productores lanzan al mercado. Estas dos acciones son comprensibles pero también están alimentando la creciente montaña de residuos electrónicos.

El mundo aplica el principio “el mejor residuo electrónico es el que no existe” por tanto la recomendación tratar mejor y contaminar menos es un plan para aplicar y hacer cumplir los prerrequisitos para una gestión ambientalmente racional de los residuos electrónicos y los COP. Sin embargo, se necesitan sistemas de financiación gubernamentales y privados para costear una gestión adecuada de los residuos electrónicos e involucrar a los actores del sector informal mediante incentivos para la recogida y entrega a instalaciones autorizadas.

3) Limitaciones de la infraestructura. A excepción de Argentina, Chile, Costa Rica, Ecuador, Panamá, Perú y Venezuela ningún otro país en la región dispone de instalaciones para el tratamiento de residuos electrónicos especializados para algunas categorías y/o determinados productos, lo que genera un sector informal muy fuerte.

Los COP en los plásticos de los residuos electrónicos se eliminan principalmente en vertederos pues ningún país dispone de instalaciones de tratamiento para su gestión, excepto Argentina. Allí existe un operador que trata y exporta productos con aislante o refrigerante de transformadores y equipos eléctricos, que por lo general contienen bifenilos policlorados (PCB) con contenidos de plaguicidas, residuos electrónicos, etc.

Costa Rica y El Salvador cuentan con plantas de cemento autorizadas para el coprocesamiento de plástico de residuos electrónicos, en particular las partes con BFR. Por consiguiente, la gestión de los residuos electrónicos queda principalmente en manos del sector informal.

La recomendación se apoya en la acción de formar más o sea entender y gestionar este complejo flujo de residuos. Cuantas más capacitaciones reciban los representantes de América Latina, mayor acceso tendrán a modelos adaptados a sus necesidades específicas para desarrollar sus propios sistemas, además de construir una red global de egresados como importante recurso de referencia.

Las Academias de Residuos Electrónicos (EWA) ─desarrolladas con base en el programa Ciclos Sustentables (SCYCLE) del Instituto de Naciones Unidas para Formación Profesional e Investigaciones (UNITAR)─ proporcionan formación a la medida y destinada a diferentes grupos interesados. Un fuerte énfasis en la diversidad de estas capacitaciones ayuda a los profesionales a informarse y a aprender en colaboración interdisciplinar.

4) Competencia entre los sectores formal e informal por los componentes valiosos de los residuos electrónicos. El tratamiento y reciclaje ilegal de los residuos electrónicos consiste en una beneficiosa actividad económica ligada a costos operativos bajos, en comparación con los procesadores oficiales. Los operadores formales, por el contrario, se encuentran en mayor desventaja económica debido a la necesidad de cumplir con una serie de procedimientos burocráticos relacionados con la legalidad de sus operaciones y por las inversiones financieras necesarias.

Otro obstáculo de la desequilibrada competencia en muchos países de la región proviene de la inexistencia de un marco legal o regulatorio que determine el desarrollo y el fomento de los operadores formales. En consecuencia, el sector informal parece que prospera más al recibir con más eficiencia, puerta a puerta, muchos materiales para reciclar los residuos electrónicos.

Pagar adecuadamente mediante acciones que integren a la cadena a los actores del sector informal es la recomendación adecuada. De esta forma los países de América Latina podrían beneficiarse de la integración entre los sectores informal y formal para los residuos electrónicos. Es un enfoque de pago justo y responsabilidad del sector informal iniciado en el pre-procesamiento: la separación en origen, la recogida y el desmantelamiento de las fracciones no peligrosas de los residuos electrónicos.

El procesamiento final, como complemento, ─reciclaje, eliminación, algunas operaciones relacionadas con pre-procesamiento de componentes peligrosos y la recuperación de piezas complejas pero valiosas─ quedaría en manos del sector formal. Enlazados, el laborioso desmantelamiento manual a nivel local podría llevarse a cabo más eficiente desde el punto de vista ambiental y económico, proporcionando oportunidades de empleo a través de inversiones de baja tecnología.

Los países de América Latina podrían permitir así el envío de los materiales de recuperación a instalaciones de procesamiento final expertas en la región o a cualquier otro lugar, donde la eliminación de la toxicidad y la recuperación general de los materiales valiosos sea más eficiente y avanzada. Este enfoque de “lo mejor de ambos mundos” resulta atractivo para los países en términos de tecnología e infraestructura de economías de escala.

5) Recopilación de datos sobre los COP contenidos en plásticos de los residuos electrónicos. En la mayoría de los países estudiados se ha empezado a recopilar información estadística sobre residuos electrónicos y COP contenidos en plásticos de los residuos electrónicos. Sin embargo, uno de los principales retos observados es el desconocimiento de las tasas de recolección.

Para el informe de Monitoreo, El Salvador, Panamá, Nicaragua y Guatemala estaban iniciando el proceso de cuantificación de los plásticos de residuos electrónicos y de COP procedentes de la recogida y procesamiento de residuos electrónicos. Aún siguen sin cuantificarse datos estadísticos sobre otros flujos de residuos electrónicos que entran en los vertederos, las actividades del sector informal, la mezcla de los residuos electrónicos con otros residuos reciclables, las importaciones y las exportaciones de residuos electrónicos y otros tipos de eliminación de residuos electrónicos.

Además faltan datos sobre los plásticos BFR de residuos electrónicos y de COP, lo que dificulta el diseño de intervenciones sustentadas en hechos para aumentar la recogida de RAEE y evaluar el impacto ambiental y las pérdidas de recursos secundarios debidas a una inadecuada gestión.

La recomendación para aumentar la recogida de datos es trabajar de forma más segura al introducir y aplicar normas de gestión de los residuos electrónicos en todos los países de la región; solo cinco las han adoptado de OIT, OMS, UIT y BRS, entre otros. Para aquellos países con legislación vigente sobre residuos electrónicos, trabajar de forma más segura equivale a revisar la norma para adecuarla a las necesidades obligatorias sobre medio ambiente, salud y seguridad.

El estudio observó que, incluso en algunos de los países con legislación vigente y sistemas de responsabilidad extendida del productor, existen problemas de aplicación relacionados a menudo con la ausencia de las obligaciones al no detallar la metodología para la organización de la recogida, transporte, procesamiento, descontaminación, tratamiento y eliminación de las piezas residuales, y la formación pertinente para todo el personal implicado.

Finalmente, la recomendación de estar más sensibilizados se hace transversal a cada una de las anteriores por cuanto podría generar un cambio en el comportamiento de los consumidores, especialmente al tener en cuenta los aspectos ambientales en el momento de la compra y al comparar los aspectos entre marcas y productos. Sería un modo de mitigar el impacto sobre el medio ambiente y la gestión de recursos.

En consecuencia, es necesario el aumento de la sensibilización a través de campañas sobre consumo en los medios sociales y de comunicación como televisión, cine, radio y periódicos. Para alcanzar a poblaciones apartadas, también son valiosos los folletos informativos junto con programas de iniciativa para las recogidas puerta a puerta, la colocación de contenedores de recogida, etc. De iniciar hábitos de adquisición ecológica mediante el potencial de los niños, como embajadores del cambio, podremos dejar de impactar la salud en el trabajo y en la comunidad general, empezando por casa.